인공지능이 시각장애인의 주변 세계를 경험하고 삶과 일하는 방식을 변화시키고 향상시키는데 도움을 주는 위해 부단히 시도되고 있다.

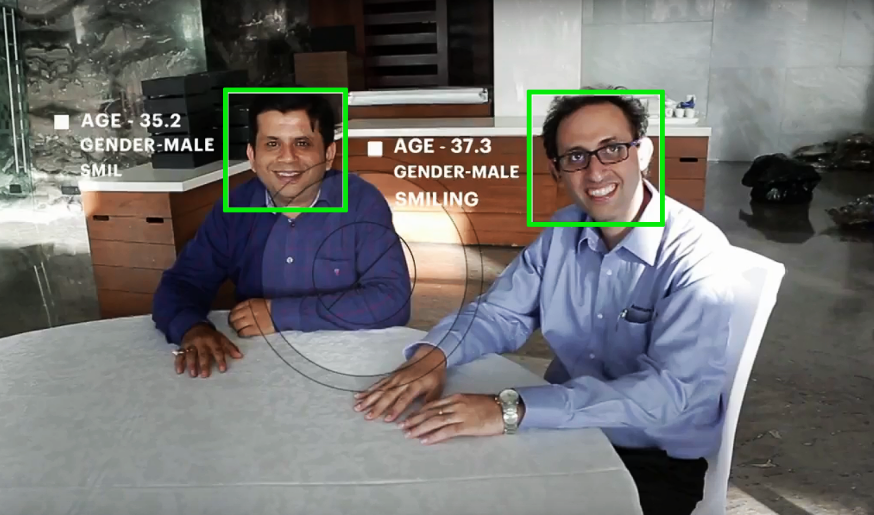

방의 인원수, 나이, 성별, 심지어 표정을 기반으로 한 상대 감정에 대해서도 사용자에게 내레이션을 제공하는 앱(APP)인 엑센츄어의 '드리슈티(Drishti: 본지기사참조)', 2010년 암논 샤슈아(Amnon Shashua) 교수와 지브 아비람(Ziv Aviram)이 공동으로 설립한 오켐(OrCam)이 개발한 AI 인공 시각(artificial vision) 웨어러블 디바이스인 '오캠 마이아이2(OrCam MyEye 2.0 : 본지기사참조)’는 신문, 책, 레스토랑 메뉴, 간판, 제품 라벨, 컴퓨터 및 스마트폰 화면 등 인쇄된 문자 또는 디지털 텍스트를 즉시 읽어준다.

특히 마이크로소프트 AI 리서치(Microsoft AI & Research)에서 개발한 응용 프로그램인 AI를 살펴보면 그 대답이 있다. 본질적으로 시각장애인 또는 시력이 약한 사용자를 위해 스마트폰을 사용하여 물건이나 색상에서 달러 지폐 또는 문서에 이르기까지 모든 것을 식별 할 수 있다. 지난해 MS ‘시잉 AI(Seeing AI)’ 앱이 출시된 이래로 이 앱은 15 만회 다운로드 되어 5 백만 건의 작업에 사용되었다고 한다.

MS의 수석 데이터 과학자인 아니르드 코울(Anirudh Koul)은 지난 달 산호세에서 개최된 엔비디아 GPU 기술 컨퍼런스에서 미숙아로 태어나 인큐베이터에서 산소 과다 공급으로 미숙아 망막증으로 시력을 잃어 청각을 토대로 음악을 만드는 역경을 이겨낸 세계적인 가수 스티비 원더(Stevie Wonder)는 매일 그 앱을 사용한다고 말하기도 했다. 또 코울의 앱의 라이브 데모는 얼마나 강력한지를 보여 줬다.

MS는 2014 년 2 월부터 주변 객체를 찾고 식별할 수 있는 컨볼루션 네트워크(convolutional neural network, CNN)를 적용해 만들기 시작했다. 그러나 대기 시간이 10 초로 빠른 의사 결정을 하려는 사람을 돕기에는 한계가 있었으며, 이듬해 MS는 13,000 명의 참가자를 끌어 모으는 해커톤(hackathon)을 후원하여 사용자의 머리에 휴대폰을 장착하는 두 번째 시도를 이끌었다.

이후 MS 코울팀은 스마트 안경사용을 실험한 끝에 응용 프로그램 자체부터 재 작업하기로 결정하고 네트워크의 로컬 학습은 엔비디아 TITAN X GPU 에서 수행되었으며 무거울 때는 엔비디아 Tesla P100 GPU를 실행하는 Azure 클라우드 인스턴스로 전달되었다. 프레임 별 분석은 각 부분이 발생할 위치를 결정하고 학습은 앱이 식별해야하는 이미지의 불확실한 특성을 반영하고 모델이 모든 유사 콘텐츠에 노출되면 결국 모든 사진을 식별하는 데 필요한 최소 매개 변수를 계산할 수 있었으며, 앱은 더 많이 사용될수록 더 똑똑하고 정확해진다.

한편 AI 기술을 사용하여 인간의 능력을 향상시켜 자신과 주변 세계를 위해 더 많은 것을 성취할 수 있는 방법들 가운데 이처럼 시각 장애인이 보다 포괄적이고 생산적인 삶을 영위할 수 있도록 하는 이미지 인식, 자연어 처리 및 자연어 생성 기능과 같은 AI 기술을 보다 접근이 쉬운 스마트폰 기반으로 제공하면서 AI가 어떻게 복잡한 인간 문제를 해결하고 향상시키기 위한 좋은 용도로 사용되는가를 보여주고 있는 대표적인 사례이다.